O Objetivo é descrever situações em tempo real para que deficientes visuais possam se localizar com facilidade.

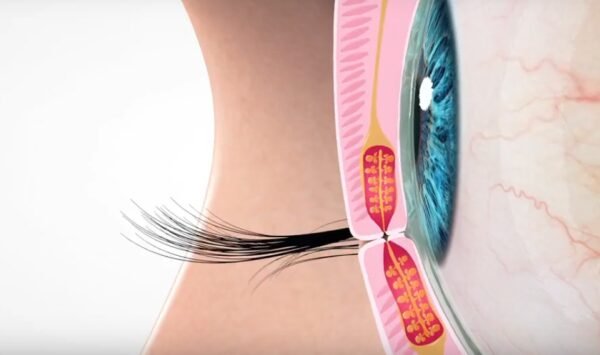

Com a finalidade de facilitar o cotidiano e gerar autonomia de locomoção e localização para deficientes visuais, a Universidade Federal de Goiás (UFG) desenvolveu o Deep Vison – Olho Eletrônico, que descreve ambientes para pessoas cegas. O aplicativo funciona a partir dos comandos de voz “veja” ou “o que tem aqui?”, que acionam a câmera do dispositivo, fotografando uma situação e, em seguida, detalha especificadamente por meio de um áudio o ambiente em que o usuário se encontra.

Segundo o pesquisador, Anderson Soares, o aplicativo terá duas funcionalidades específicas, sendo a primeira, a descrição de ambientes e a segunda, um direcionamento sensorial de trânsito, no qual a câmera captará objetos em movimento e obstáculos, o que gera um efeito sonoro no fone de ouvido. “A ideia é que o app colabore com os mecanismos de acessibilidade já existentes, permitindo que o usuário se localize com total autonomia, sem precisar de outro indivíduo”, afirma.

O aplicativo estará disponível para download até o final deste ano e o seu funcionamento dependerá de conexão com a internet. Já para 2019, pensando na realidade brasileira, o objetivo é a criação de um óculos eletrônico com as mesmas funcionalidades, mas que não faça uso de banda larga. O projeto conta com um site para que qualquer pessoa possa realizar um teste e entender como o software funciona.

Redes Neurais

A aprendizagem profunda, conhecida como Deep Learning, é uma das vertentes mais prevalentes do mundo computacional pois promove o entendimento de imagens, explica o pesquisador, Otávio Calaça. Segundo ele, a partir dessa funcionalidade, o aplicativo utiliza quatro redes neurais com aproximadamente 400 milhões de parâmetros que fazem o reconhecimento de imagens. A primeira rede é responsável por fazer o reconhecimento da voz do usuário, acionando a câmera para a captura da foto eletrônica.

“Em seguida, a segunda rede capturará os detalhes da imagem que foi tirada pela câmera, acionando a terceira rede que irá vincular os detalhes capturados em uma espécie de texto”, afirma. O pesquisador aponta que, por fim, a última rede neural será acionada para um processamento de voz, gerando um áudio tanto em inglês quanto em português, para descrever a situação em que o usuário se encontra.

Fonte: O Popular

Navegação

Ajudam a tornar um site utilizável, permitindo acesso a funções básicas, como navegação de página e a áreas seguras do site. O site não pode funcionar corretamente sem esses cookies.

Estatísticas

Coletam dados e informações anonimamente sobre o uso do site. Dessa forma, nos ajudam a melhorar nosso site a partir dessas informações.

Marketing

Permitem que você compartilhe nosso conteúdo nas suas redes sociais. E são usados para rastrear visitantes em sites. O objetivo é otimizar as campanhas publicitárias.

Preferências

Permitem que um site se lembre de informações que mudam a forma como ele é exibido, como armazenamento de moedas, o idioma de sua preferência ou a região em que você está localizado.